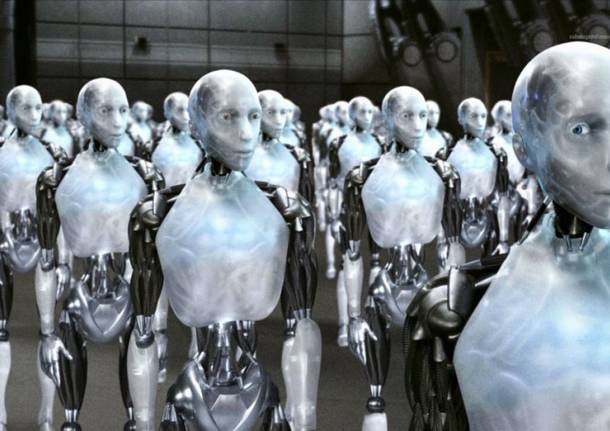

L’Intelligenza artificiale, con i suoi possibili sviluppi e applicazioni, è un argomento che scotta. Negli ultimi tempi, i maggiori rappresentanti politici, economici e scientifici sono chiamati in causa per conoscere il loro parere: favorevoli o contrari? Timorosi o affascinati? Da qualunque lato si guardi la questione, i robot che invadono il nostro futuro sono una prospettiva ben poco allettante, in particolare per scopi che non riguardano né l’aiuto alla comunità né la facilitazione delle nostre azioni quotidiane.

Devono aver pensato questo e altro Elon Musk e altri 116 fondatori di aziende di A.I. e robotica quando, circa un mese fa, a Melbourne, hanno firmato una lettera chiedendo di bloccare la corsa agli “armamenti autonomi”.

Leggi anche: Elon Musk profeta contro tutti: la Terza Guerra Mondiale sarà causata dai robot

Il rischio dei soldati robot

Ci è voluta una lettera per la seconda volta. Già nel 2015, al medesimo convegno annuale della International Joint Conference on Artificial Intelligence (IJCAI), era stata sottoscritta una carta con i nomi più autorevoli del settore della ricerca universitaria e scientifica. Un esponente per tutti: Stephen Hawking, che insieme ad un centinaio di studiosi, aveva esplicitato il proprio dissenso per l’implicazione di soldati robot nei conflitti militari.

Quest’anno il monito all’ONU è stato ribadito da Musk e colleghi affinché sia vietato l’utilizzo di armamenti autonomi. Il suo invito, insieme a quello degli altri fondatori, è rivolto ai partecipanti del GGE (Esperti Governativi) ed cè quello di: “sforzarsi di trovare modi per prevenire una corsa agli armamenti autonomi, per proteggere i civili dagli abusi e per evitare gli effetti destabilizzanti di queste tecnologie.

Le armi letali autonome minacciano di essere la terza rivoluzione in campo militare. Una volta sviluppate, permetteranno ai conflitti armati di essere combattuti su una scala più grande che mai, e su scale temporali più veloci di quanto gli umani possano comprendere: sono armi che despoti e terroristi potrebbero rivolgere contro popoli innocenti, oltre che armi che gli hacker potrebbero riprogrammare per comportarsi in modi indesiderabili”.

Leggi anche: Robot e responsabilità. Nuove norme dall’UE

Un pericolo senza precedenti

Chi è a favore dell’A.I. impiegata nei conflitti militari non sa bene di cosa si tratti realmente. Perché la questione riguarda anche le responsabilità da attribuire per ogni eventuale “falla” nel sistema. Ovvero: i soldati robot saranno dotati di reti neurali che andranno a formare una scatola nera capace di prendere decisioni. Il problema è proprio questo: saranno decisioni giuste? Il robot eviterà civili e innocenti? Purtroppo non conosciamo la risposta. E se accadrà qualcosa di inevitabile, a chi dare la colpa? Ad una macchina? Chi si prenderà la responsabilità di una strage?

Le scottanti questioni riguardo l’A.I. vogliono scongiurare l’attacco dei robot verso gli esseri umani. Inoltre, hanno il pregio di far riflettere anche sulla guerra stessa, sui conflitti moderni, che non hanno più senso di esistere perché ormai le vere risorse per cui si lotta sono quelle mentali e non più i terreni conquistabili con le milizie militari.